PolifonIA.org | Carlos Macías (CIESAS). El año de 2026 será decisivo en el terreno de la regulación de la IA en América Latina.

Es probable que los países no lleguen a contar en el futuro con “una” sola Ley de Inteligencia Artificial, como tampoco quizá será suficiente que tengan “una” Ley de Digitalización o “una” Ley del Internet.

Las dimensiones que ocupará la adopción progresiva de la inteligencia artificial entre las personas, los gobiernos y las empresas, son numerosas y diferenciadas. Difícilmente podrán integrarse en un solo documento tan encontradas motivaciones e imperativos sectoriales, como para ser atendidos con el cuidado que reclama cada uno.

Pero no adelantemos la conclusión de este artículo.

- Proyectos nacionales a la expectativa de un modelo

- La influencia de Europa en la normatividad

- The Brussels Effect y la Europa menguante

- Efecto Delaware en Estados Unidos

- El enfoque de cuatro riesgos (que llegó para quedarse)

- Enfoque de cuatro riesgos

- Enfoque europeo de riesgos en la regulación IA

- Una mirada basada en la contención de los efectos de la IA

- La IA es hoy un asunto geopolítico: se escuchan los pasos de la AGI

- Escenarios de la AGI que inquietan

- Open Brain

- ¿Qué hacer?

- Estado de la normatividad IA en Latinoamérica: de sur a norte

- Chile toma la batuta (2024), con el modelo IA europeo

- La ANID chilena

- El Ministerio de Ciencia chileno, la ANID y la Inteligencia Artificial

- La propuesta chilena de regulación IA (2024)

- Modelo de riesgo chileno

- El reto de la innovación

- Ponerse de acuerdo en la Argentina

- Brasil matiza (pero mantiene) el modelo europeo basado en riesgo

- Énfasis en derechos de las personas

- La experiencia peruana

- México: la aplazada transformación digital

- Iniciativas en espera de análisis en el Congreso mexicano

- Propuestas normativas relacionadas con la IA en México

- El doblaje de voz

- En suma, ¿qué países latinoamericanos muestran mayor avance regulatorio IA?

- Costa Rica

- República Dominicana

- Conclusión

- Fuentes:

- 📌 Fechas Críticas 2025-2026

- 🇧🇷 Brasil – Líder Regional

- 🇨🇱 Chile – Protección de Datos

- 🇨🇷 Costa Rica – Doble Vía

- 🇩🇴 República Dominicana

- 🇦🇷 Argentina – Mosaico Normativo

- 🇵🇪 Perú – Base de Datos

- 🔑 Hallazgos Clave del Artículo

Proyectos nacionales a la expectativa de un modelo

Por lo pronto, el lector apreciará aquí los innumerables proyectos normativos nacionales que se encuentran en proceso de revisión. Las propuestas descansan (y en ocasiones fenecen) en los Congresos o en las Asambleas Legislativas de cada país.

Pareciera que están a la expectativa de la ruta que tome la normatividad en otros países. Que están atentos, también, para calibrar con precisión el tipo de avances palpables que registra la IA en los distintos espacios productivos, laborales, educativos, financieros, éticos, en salud y tecnológicos, entre muchos otros.

La influencia de Europa en la normatividad

Una breve recuperación cronológica inicial (2020-2025), resultará central para dimensionar de modo apropiado los tiempos actuales.

Debe reconocerse que heredamos la influencia de Europa. Sea por el arraigo de sus notables instituciones de prolongada exportación o, bien, por su extendida presencia cultural, política, lingúística y -desde luego- económica, de carácter multicentenaria, en los circuitos ultramarinos.

Por contraste, asistimos también -a inicios de 2026- a un nuevo teatro mundial: una geopolítica en transición.

The Brussels Effect y la Europa menguante

Todavía hace cinco años, la profesora Anu Bradford, de la Escuela de Derecho de Columbia, aludía con acento a la fuerte prevalencia de Europa.

De hecho, desde aquel artículo que escribió en 2012 (donde acuñó la frase «The Brussels Effect») se había vuelto ya una autora de referencia. Como se sabe, la sede de la Unión Europea se ubica en Bruselas.

Aquel texto validó el desestimado poder global que aún ejerce la Unión Europea, por vía de la proyección de sus instituciones y de sus normas jurídicas. Una perdurable exportación hacia el resto del mundo.

El artículo de 2012 se dedica a revisar el llamado “Efecto California” en los Estados Unidos. Destaca la capacidad regulatoria californiana y la necesidad de aplicar normas estrictas en general (en un contexto en que “las empresas pueden constituirse en cualquier estado”).

Efecto Delaware en Estados Unidos

Ello, en contraste con la aparente flexibilidad que propicia el “Efecto Delaware”, para atraer inversión.

Pero la idea que nos parece interesante del texto, podría adquirir hoy una aplicación extensiva a otros países. Señala:

“Las siguientes condiciones son necesarias para que una jurisdicción dicte reglas para el comercio global: la jurisdicción debe tener un gran mercado interno, una capacidad regulatoria significativa y la propensión a aplicar normas estrictas sobre objetivos inelásticos (por ejemplo, los mercados de consumo), en lugar de objetivos elásticos (por ejemplo, el capital).”

¿Cuál sería la relevancia actual de esta larga cita?

Creemos que lo relevante de esa interpretación que procede de 2012 -si se aplicara hoy al fomento de la Inteligencia Artificial-, es el cambio institucional que se experimenta en los Estados Unidos en 2025.

Es decir, el hecho de que la consignada capacidad regulatoria y la aplicación de normas estrictas (para atender objetivos inelásticos) parecen estar siendo relativizadas por la orden ejecutiva de la Presidencia de los Estados Unidos, del pasado 11 de diciembre de 2025, que hemos reseñado antes.

El enfoque de cuatro riesgos (que llegó para quedarse)

En el último llustro, el título de aquel artículo de 2012 se reitera, cuando se desea destacar el papel de Europa en el futuro de la IA.

En años recientes, esta profesora finlandesa-estadounidense volvió a subrayar la prevalencia de Europa.

Su libro de 2020 acude también al papel influyente de Europa. Lo tituló de nuevo The Brussels Effect: How the European Union Rules the World, Faculty Books (2020).

Bradford define todavía a Europa como…

“una superpotencia influyente que moldea el mundo a su imagen.«

«Al promulgar regulaciones que moldean el entorno empresarial internacional, eleva los estándares a nivel mundial, conduce a una notable europeización de muchos aspectos importantes del comercio global.«

«La UE ha logrado dar forma a las políticas en áreas como la privacidad de los datos, la salud y seguridad del consumidor, la protección del medio ambiente, la lucha contra la competencia y el discurso de odio en línea.” [Véase la descripción de la obra, en Columbia Law School].

Por ahora, la visión de Bradford es convergente con la manera en que Europa ha marcado la agenda IA -con sus ejes de regulación-, para ayudar a modelar las propuestas en los países emergentes.

(Con Estados Unidos no ocurre lo mismo. Ya lo analizamos en un artículo anterior, la orden ejecutiva emitida por el Presidente Trump el 11 de diciembre de 2025, que dispone los ejes para la IA, conserva visos de centralización).

Enfoque de cuatro riesgos

Vale señalar que la ruta de trabajo para regular la IA inició en Europa desde 2021. En ese momento, la Comisión Europea culminó una propuesta legislativa para considerar el Reglamento General de IA.

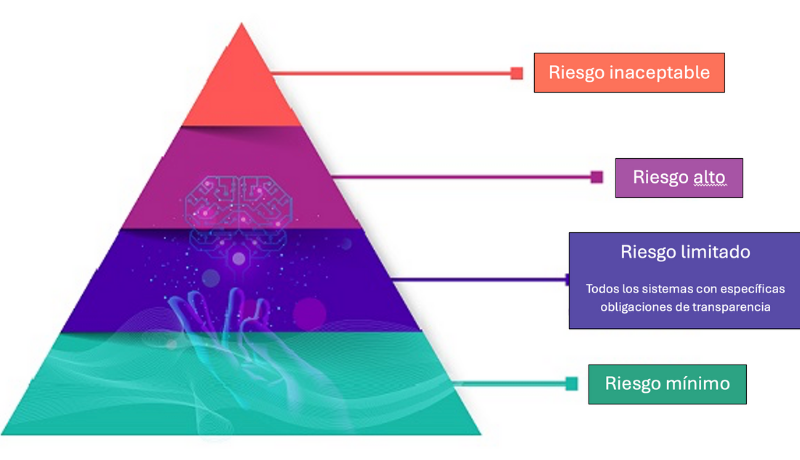

Ahí nació justo el enfoque basado en cuatro riesgos: inaceptable, alto, limitado y mínimo.

Tres años más tarde, en mayo de 2024, el Consejo de la Unión Europea decidió su aprobación.

De modo que el “efecto Bruselas” sigue vivo. Ha resultado predominante ese enfoque de riesgos en los anteproyectos de regulación de la Inteligencia Artificial en América Latina. Así lo consignaremos aquí.

Así permanece, al menos hasta ahora (principios de 2026).

Enfoque europeo de riesgos en la regulación IA

En el plano programático acentúa la noción del riesgo, como un componente central de la Inteligencia Artificial.

Desde nuestro punto de vista, no es que el riesgo no sea un componente de la IA. ¿Pero es el central?

Diríase, la perspectiva europea toma como punto de partida el enfoque precautorio y normativo en cuatro niveles de riesgo, que parece no colocar con la relevancia suficiente a la práxis de innovación.

- Prohibiciones categóricas: estigmatización social; manipulación subliminal y reconocimiento facial en tiempo real.

- Rendición de cuentas: obligaciones para desarrolladores y emisores.

- Transparencia: explicitar eventual afectación en decisiones automatizadas.

- Derechos: privacidad, dignidad humana, no discriminación.

Enfoque europeo del riesgo (cuatro niveles para sistemas de IA). Configurar el futuro digital de Europa.

Una mirada basada en la contención de los efectos de la IA

Es muy probable que en 2026 entren en vigor en nuestros países diversas leyes y reglamentaciones, bajo un aparente denominador común -desde nuestro punto de vista-: el predominio conceptual de la regulación propuesta por la Comisión Europea en 2021, basada en las escalas de riesgo.

(Si deseas conocer la ruta de trabajo que marca la regulación europea, la hemos comentado con amplitud en un artículo previo).

Lo relevante es que, hasta ahora, en casi todas las leyes y proyectos de leyes IA latinoamericanas apreciamos una visión -digamos- defensiva. Priva esa mirada basada en la contención: con énfasis en el velo tutelar de derechos ante el avance de la IA.

Y esa visión preventiva no parece ser suficiente ante la inaplazable incursión de nuestros países en los sistemas emergentes de Inteligencia Artificial. Veamos por qué.

La IA es hoy un asunto geopolítico: se escuchan los pasos de la AGI

La Inteligencia Artificial General (AGI) la podemos caracterizar como el escenario culminante, la summa tecnológica contemporánea de la IA.

En esa etapa inminente, ante tal expectativa por llegar -se prevé-, la Inteligencia Artificial General asumirá de modo ineluctable toda la capacidad intelectual que por ahora sólo le es propia al ser humano.

Lo más probable es que la llegada de la AGI pueda ocurrir en la forma de una confluencia masiva de agentes, animados por los más avezados LLMs, los cuales, a su vez, estarán equipados generosamente con TPUs (o lo que les siga). Así lo planteamos en un artículo anterior.

(Nota: acerca de la definición de los llamados agentes, LLMs y TPUs, al hacer clic en cada enlace de color naranja se podrá encontrar la caracterización que hemos presentado de cada uno de ellos).

Escenarios de la AGI que inquietan

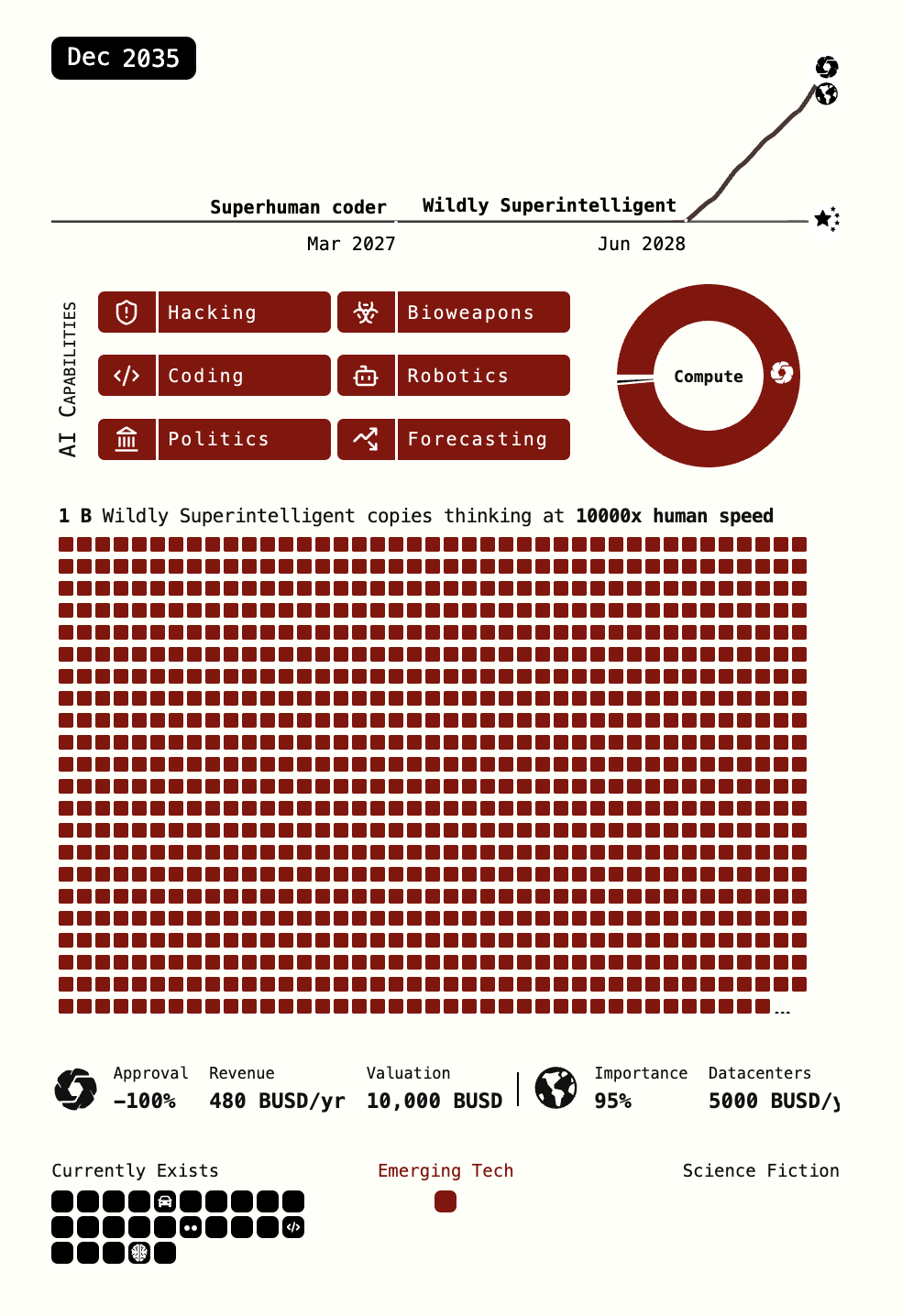

Los escenarios del desenvolvimiento de la Inteligencia Artificial General, que plantean los autores Daniel Kokotajlo, Scott Alexander, Thomas Larsen, Eli Lifland y Romeo Dean, resultan atractivos, aunque -creemos- con el bemol del apresurado ritmo anticipatorio.

Su texto (IA 2027) prodiga un escenario alternativo (que ya instalados en 2026, bien podría funcionar incluso como una historia contrafactual).

El formato de su publicación electrónica es muy atractivo. Es completo, intuitivo y muy profesional.

Los autores nos informan que su modelo “está basado en extrapolaciones de tendencias, simulacros de guerra, comentarios de expertos, experiencia en OpenAI y pronósticos exitosos anteriores”.

El coordinador del equipo, Daniel Kokotajlo, laboró previamente como investigador en gobernanza de OpenAI, encargado de la planificación de escenarios.

Open Brain

El artículo referido (IA 2027) busca transmitir una evolución posible de la geopolítica inmediata de la Inteligencia Artificial (2026-2029).

En especial, porque introduce la participación protagónica china, en un contexto de alta competencia corporativa, en el desarrollo e influencia de lo que definen como etapas de OpenBrain.

¿Qué es el OpenBrain? Podemos entenderlo como un ente híbrido hipotético (podría ser una empresa), que está llamada a ser dominante. Un sólido LLM actual, digamos.

OpenBrain, de acuerdo con los autores, congrega a numerosos centros de datos, a la vez que encarna a la empresa depositaria del honor de haber desarrollado el horizonte deseable en 2026 o 2027: la Inteligencia Artificial General (la famosísima AGI).

Como se podrá ver, el recuento lleva hasta 2029, bajo una senda anual guiada por tensiones geopolíticas.

La evolución de los agentes 1-5 tomarán la batuta durante esos años, de modo que traducirán cierta tensión geopolítica en el mundo, en busca del liderazgo tecnológico, para arribar a la etapa culminante: su despliegue en el espacio.

La reseña de los caminos hipotéticos que tomará la IA concluye en 2030, justo cuando “la nueva década amanece con los servidores robóticos de Consensus-1, extendiéndose por todo el sistema solar.” [Véase 2030: Takeover]. La conclusión presumible resulta sobrecogedora.

¿Qué hacer?

En tal contexto, nuestra convicción es que los países emergentes quedarán atrás (en particular, los latinoamericanos), si no le imprimen una mayor cobertura a su política nacional sobre la IA (en esencia, a su regulación).

Hablamos de una política y una regulación que esté en condiciones de asegurar la más amplia colaboración y sinergia (articulación) del trabajo de los científicos y tecnólogos, de las corporaciones que cuentan con infraestructura tecnológica y del gobierno nacional, en el impulso y desarrollo de los sistemas de IA.

Estado de la normatividad IA en Latinoamérica: de sur a norte

Avanzar en la regulación de la IA en cada país latinoamericano no ha sido tarea fácil en el último par de años (2024-2025).

En primer lugar, porque las numerosas expresiones tecnológicas que prodiga la IA se encuentran en proceso de adaptabilidad.

La IA se guía por un ritmo diferenciado en su aplicación y en el uso social en el que éste permea de modo creciente. Se diría que la IA está en pleno desenvolvimiento y maduración.

En segundo lugar, porque el proceso de armonización normativa y de consulta necesarios entre los sectores de cada país no se logra por decreto.

Requiere que se cumplan diversas etapas y reglamentaciones secundarias (protección de datos, financiamiento, transformación digital, impacto sectorial, fondeo de proyectos, etcétera), para un avance sostenible, y así alcanzar una culminación idónea.

Chile toma la batuta (2024), con el modelo IA europeo

La política de impulso a la Inteligencia Artificial en Chile va de la mano con la creación del Ministerio de Ciencia, Tecnología, Conocimiento e Innovación, el 1 de octubre de 2019.

También va de mano con la nueva Política Nacional de Ciencia, Tecnología, Conocimiento e Innovación, simultánea a la creación del Ministerio. Esta Política Nacional fue producto de un conjunto intenso de consultas. Se publicó en octubre de 2020.

El Ministerio de Ciencia de Chile se creó para sustituir -como en México- a la Comisión Nacional de Investigación Científica y Tecnológica (CONICYT).

El Ministerio de Ciencia de Chile se alimentó con personal que provino de la subsecretaría de Educación y de la subsecretaría de Economía.

La ANID chilena

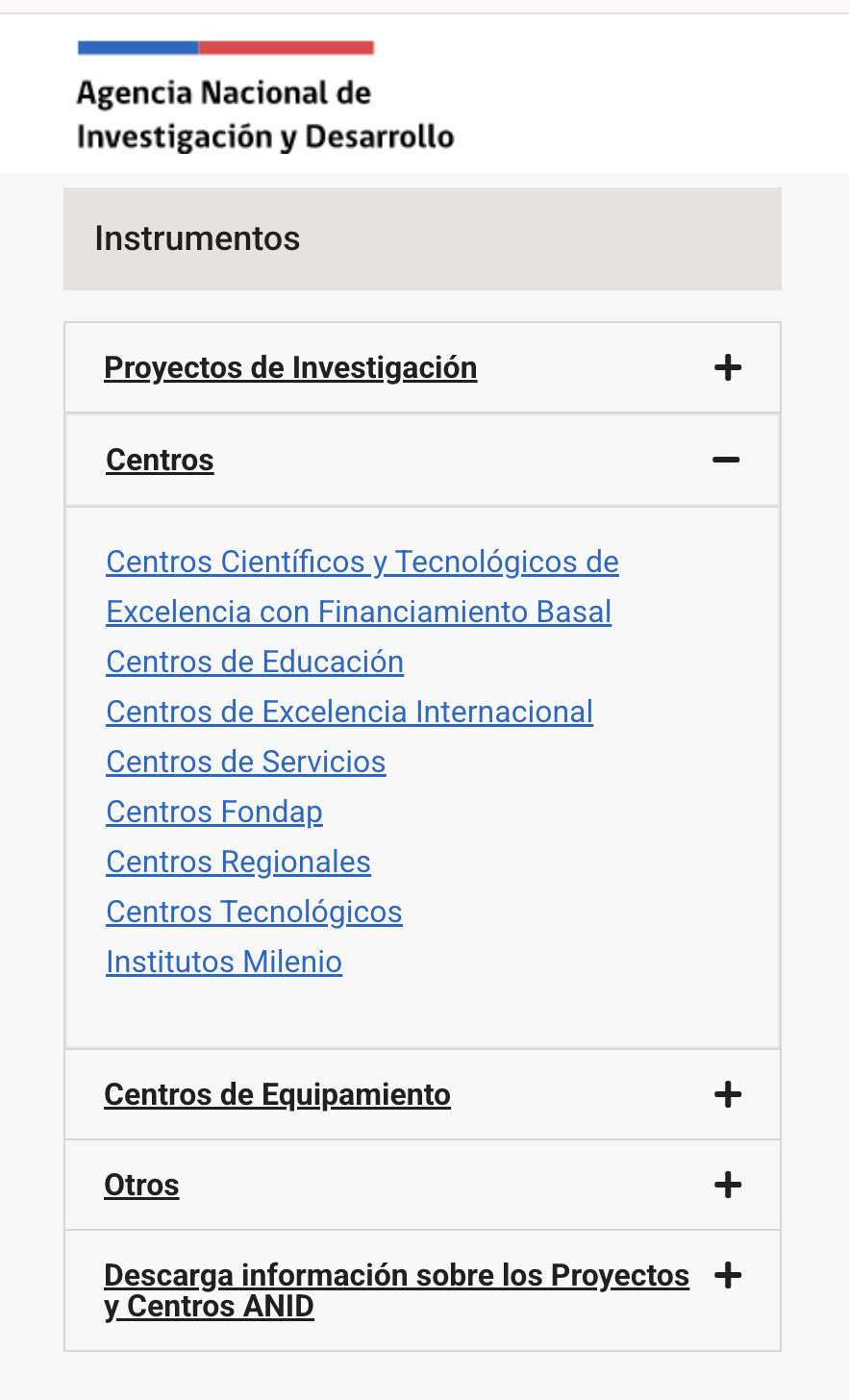

Pero, como destacamos en un texto escrito en 2024, existe una diferencia entre el nuevo modelo de fomento científico y tecnológico que se creó en México, respecto del modelo chileno. En el país andino, los Centros Públicos de Investigación permanecieron adscritos al nuevo Ministerio, dentro de un nicho institucional que les fue creado ex profeso: la Agencia Nacional de Investigación y Desarrollo (ANID).

La ANID es una Agencia de Estado. Es la esfera adscrita al Ministerio de Ciencia chileno responsable de administrar las becas y los programas de posgrado, así como los concursos de investigación en todas las áreas del conocimiento. Todo lo hace de conformidad con las políticas del Ministerio de Ciencia.

La ANID tiene bajo su coordinación a los distintos Centros de Investigación Asociativa, a las Redes y a los Fondos de Investigación (Fondecyt).

El Ministerio de Ciencia chileno, la ANID y la Inteligencia Artificial

Como resultado de la primera Política Nacional de Ciencia, Tecnología, Conocimiento e Innovación, del Ministerio de Ciencia chileno, el presidente Sebastián Piñera encargó a la nueva institución atender en 2020 los desafíos que presentaban las herramientas digitales.

Para ello, el Ministerio de Ciencia inscribió como segundo eje de su nueva Política Nacional -que definió como “Futuro”- el aprovechamiento del conocimiento, la ciencia y la tecnología, y la atención a la Inteligencia Artificial.

Así, Chile publicó su primera Política Nacional de IA en 2021.

Para posibilitar su diseño y preparación, se organizaron entre 2020 y 2021 diferentes talleres de consulta, en los que participaron más de 1,300 personas.

Asimismo, en cada una de las regiones del país se realizaron encuentros, donde se congregaron 400 personas.

Para sistematizar las distintas perspectivas disciplinarias, se organizaron -además- 15 encuentros nacionales, en los que se dieron cita 5,300 personas.

Como fruto de todo ello, se fundó el Centro Nacional de Inteligencia Artificial (CENIA), se impulsó la concesión de becas de doctorado para IA, con la participación de la Agencia Nacional de Investigación y Desarrollo (ANID).

Se creó el primer doctorado de IA en Chile y en Latinoamérica. [Véase la Política Nacional de Inteligencia Artificial y Plan de Acción].

La propuesta chilena de regulación IA (2024)

El gobierno de Chile, por vía del Ministerio de Ciencia, difundió el 7 de mayo de 2024 la propuesta parlamentaria que retomó algunos debates previos.

La propuesta de regulación chilena podría considerse la más completa y consensuada hasta hoy (al lado de la brasileña, la costarricense y la peruana).

La iniciativa aún se encuentra en la etapa de trámite legislativo. Por ahora es analizada por la Comisión de Futuro, Ciencia, Tecnología, Conocimiento e Innovación, de la Cámara de Diputadas y Diputados, así como por el Senado. Se espera entre en vigor en 2026.

Esta iniciativa ha sido fruto de la consulta entre el Comité de Expertos de IA, las comisiones del Congreso, así como las mesas de trabajo con la industria, la academia y la sociedad civil.

Está inspirada en la documentación sectorial de la Unesco y de la OCDE, pero sobre todo de la Unión Europea. (Véase nuestro análisis comparativo de regulación de la Unión Europea).

De modo comprensible -como la mayoría de las iniciativas latinoamericanas- está basada en el enfoque de riesgos, que es la esencia del modelo de la Comisión Europea establecido en 2021. El artículo 7 de la iniciativa chilena contempla el enfoque de riesgo como parte de una actividad continua: “un proceso iterativo continuo de evaluación”, que implica realizar revisiones periódicas.

Modelo de riesgo chileno

La iniciativa chilena establece con claridad aquellos sistemas que comportan alto riesgo.

Los sitemas de alto riesgo han sido caracterizados con base en los probables “perjuicios para la salud, la seguridad y los derechos fundamentales”, que son contemplados por la Constitución de la República de Chile. Pero también aquellos vinculados con el medio ambiente y los consumidores.

Como la regulación europea que hemos expuesto antes, clasifica el riesgo en cuatro niveles, donde el riesgo mayor es el inaceptable (prohibido), además del alto, medio y bajo.

El diseño de la estructura institucional que se dedicará a fiscalizar los umbrales de riesgo, se realizó de manera simultánea: se trata de la nueva Agencia de Protección de Datos Personales.

La Agencia de Protección de Datos Personales de Chile se creó, finalmente, con la Ley del 13 de diciembre de 2024, pero deberá entrar en vigor hasta el 1 de diciembre de 2026.

Desde nuestro punto de vista, la iniciativa chilena también posee un enfoque de contención ante la inteligencia artificial. Está ubicada sin duda en las coordenadas del modelo europeo.

Es decir, prioriza la garantía de protección de los datos personales y de los derechos individuales. Es reactiva. Tiende por ello a colocar el velo tutelar, y a anteponer valladares ante los posibles efectos adversos del avance de la tecnología.

El reto de la innovación

No acentúa (ni parece promover con prioridad) el correspondiente despliegue de dicha industria en el país.

No es extraño que el Ministerio de Ciencia llegue a preguntarse si acaso su Iniciativa podría restar incentivos a la innovación. Y se responde de esta manera:

“No, todo lo contrario. Esta Ley impulsa la innovación al establecer reglas claras. Permite probar nuevas tecnologías en espacios controlados, sin asumir todos los riesgos, y apoyar especialmente a las pequeñas y medianas empresas que desarrollan soluciones con IA.” [Véase el Proyecto de Ley que regula los sistemas de IA en Chile].

Si se debiera plantear un resumen para fijar aquellos espacios concretos de carácter preventivo que la iniciativa de Chile parece priorizar, los siguientes serían -desde nuestro punto de vista- los dos principales:

- Garantizar que los algoritmos no lleguen a discriminar a la población usuaria por razones de género, origen, edad u orientación sexual.

- Asegurar que cuando se use la IA en labores asociadas con la salud, la educación o los servicios públicos, se cumplan los estándares éticos y de seguridad predefinidos.

Ponerse de acuerdo en la Argentina

Como en otros países, en Argentina han abundado al menos desde hace un lustro las iniciativas parlamentarias para normar la aplicación y el desarrollo de la Inteligencia Artificial.

El hecho es que, también como ocurre en otros países latinoamericanos, aún no se cuenta con una Ley aprobada por el Congreso, a juzgar por el respaldo informativo que nos ofrece el Dossier Legislativo (2025) de la Biblioteca del Congreso de la Nación, de Argentina.

Cierto que en 2024 los diputados y senadores impulsaron un marco regulatorio, pero éste no ha podido avanzar.

Del mismo modo, en 2025 los diputados de oposición propusieron un documento breve, llamado también Marco regulatorio para el desarrollo, implementación y uso de la Inteligencia Artificial (IA) en la Administración Pública Nacional. (curioso que sea “en la Administración Pública Nacional”).

Como sea, a falta de una alternativa que luzca por el momento factible, conviene aquí ofrecer una idea del panorama normativo de Argentina.

Para ello, enlistaremos algunos documentos normativos asociados de manera colateral con la AI, que están en aplicación.

- “Disposición N° 2/23 de la Subsecretaría de Tecnologías de la Información: Recomendaciones para una Inteligencia Artificial Fiable;

- Resolución N° 161/23 de la Agencia de Acceso a la Información Pública: Programa de transparencia y protección de datos personales en el uso de la Inteligencia Artificial;

- Decisión Administrativa N° 750/23: Mesa Interministerial sobre Inteligencia Artificial;

- Resolución N° 90/21 de la Secretaría de Asuntos Estratégicos: Programa de Inteligencia Artificial;

- Ley N° 27.736 (2023), modificatoria de la Ley Nº 26.485 (2009) de Protección integral para prevenir, sancionar y erradicar la violencia contra las mujeres, incorpora la violencia de género digital a la normativa de protección integral de la mujer; y

- Resoluciones N° 428/24 y 710/24 del Ministerio de Seguridad de la Nación: Unidad de Inteligencia Artificial aplicada a la Seguridad (UIAAS) y regulan su funcionamiento”. [Véase el Dossier Legislativo, julio 2025].

Brasil matiza (pero mantiene) el modelo europeo basado en riesgo

Este país sudamericano se encuentra entre los precursores del esquema de regulación dominante de la IA en la región latinoamericana.

El antecedente mayor de la regulación es el proyecto de Ley aprobado por el Senado brasileño, el 21 de noviembre de 2020, que «Establece las bases, principios y directrices para el desarrollo y la aplicación de la inteligencia artificial en Brasil».

Fue una ley temprana, pero incorporó los ingredientes centrales que debe contener toda ley de IA de un país emergente que busca impulsar la innovación, mediante una visión integral.

La ley de IA de Brasil constó de nueve artículos. El artículo 4 reconoció que los fundamentos para el desarrollo de la Inteligencia Artificial en Brasil estarían basados en los siguientes aspectos:

- el desarrollo científico y tecnológico, así como en la innovación;

- la libre empresa y la libre competencia;

- el respeto a la ética, los derechos humanos y los valores democráticos;

- la libre expresión del pensamiento y libertad intelectual, artística, científica y de comunicación;

- la no discriminación, pluralidad, respeto a la diversidad regional, inclusión y respeto a los derechos y garantías fundamentales de la ciudadanía; y

- el reconocimiento de su naturaleza digital, transversal y dinámica. [Véase la Ley 2020].

Ello permitió avanzar con relativa agilidad en la maduración normativa, no sin revisar con cuidado las aportaciones europeas de 2021.

Énfasis en derechos de las personas

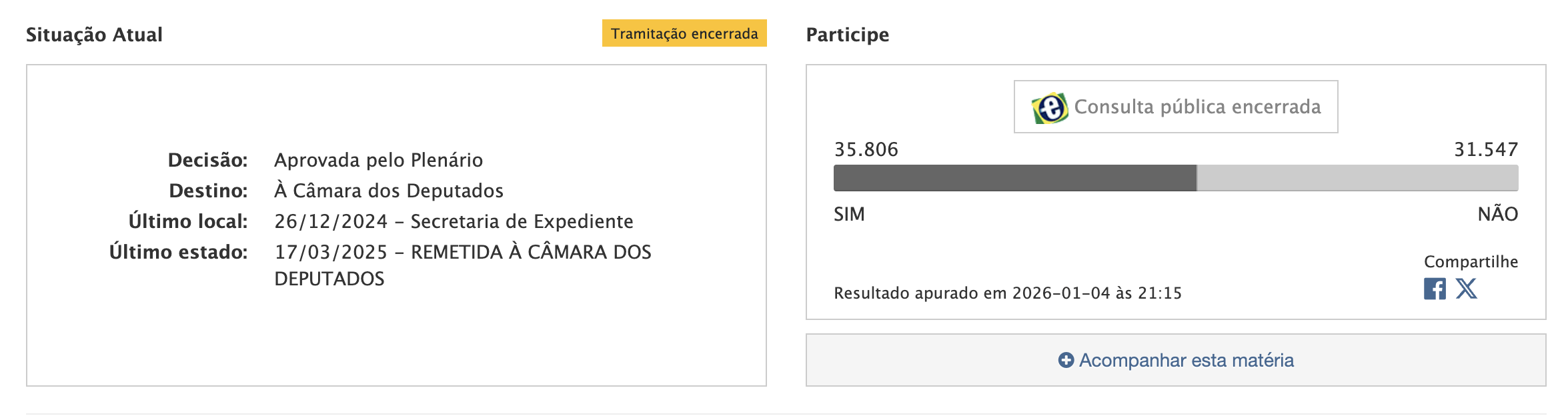

Ahora se cuenta con una propuesta legislativa más ambiciosa, contenida en el Proyecto de Ley 2338/2023 (PL 2338/2023), que habrá de establecer el Marco Legal de la Inteligencia Artificial.

Plantea como objetivo mayor “proteger los derechos fundamentales y garantizar la implementación de sistemas seguros y confiables, en beneficio de la persona humana, el régimen democrático y el desarrollo científico y tecnológico”. [Artículo 1].

En esta iniciativa han participado cerca de 70 mil personas con su opinión electrónica. Ya ha pasado por el Senado. Se encuentra en la Cámara de Diputados y se espera que entre en vigor en 2026.

Este Proyecto de Ley considera que el desarrollo, la implementación y el uso de sistemas de inteligencia artificial en Brasil, deberán considerar, entre otras prioridades:

- la centralidad de la persona humana;

- el respeto a los derechos humanos y a los valores democráticos;

- el libre desarrollo de la personalidad;

- la protección del medio ambiente y el desarrollo sostenible;

- la igualdad, la no discriminación, la pluralidad y el respeto a los derechos laborales; y

- el desarrollo tecnológico y la innovación. [Artículo 2].

El modelo brasileño es un modelo similar al europeo, pero replantea las categorías de riesgo (de hecho, las reduce a sólo dos).

Considera con mayor peso las modalidades de riesgo excesivo (sistemas prohibidos)y de riesgo alto.

Como el europeo, en riesgo excesivo prohíbe los sistemas que usen técnicas subliminales para manipular el comportamiento, los sistemas de puntuación social, o que aprovechen vulnerabilidades de grupos concretos (niños o ancianos).

En riesgo alto tipifica un estándar de transparencia, seguridad y gobernanza en aquellos sectores de interés: salud, transporte, identificación biométrica y selección de personal. [Artículos 14-18].

Como en Chile, donde se tomó como prioridad la protección de datos, este Proyecto de Ley brasileño establece que el ente regulador de la inteligencia artificial descansará en la figura de una Autoridad Nacional de Protección de Datos (ANPD).

Vale decir, que la ANPD es anterior a las tentativas de legislación sobre Inteligencia Artificial en Brasil. La ANPD de Brasil fue creada en 2018, en el marco de la aprobación de la Ley General de Protección de Datos.

La experiencia peruana

La Ley de Protección de Datos brasileña fue, por cierto, simultánea a la creada en Perú (en 2017), la cual también dio origen a su respectiva Autoridad Nacional de Protección de Datos (ANPD peruana).

Sin embargo, en Perú la Ley de Inteligencia Artificial (Reglamento de la Ley n° 31814) se expidió desde 2023, y fue reglamentada hace unos meses, en septiembre de 2025.

La Ley de IA peruana mantiene como ente regulador a la Secretaría de Gobierno y Transformación Digital, que depende de la Presidencia del Consejo de Ministros.

Esta Secretaría de Gobierno y Transformación Digital es la responsable de “dirigir, evaluar y supervisar el uso y la promoción del desarrollo de la inteligencia artificial y las tecnologías emergentes”. [Véase la Ley IA de Perú].

México: la aplazada transformación digital

Para México, uno de los primeros planes gubernamentales que incorporó en la agenda aquellos desafíos integrales del desarrollo digital, dentro de las actividades públicas prioritarias, fue la Estrategia Digital Nacional (EDN) de 2013.

Entonces, el referente del gobierno mexicano partía -como había ocurrido desde mediados de la década de 1990- de las lecciones que arrojaban las cifras promedio de los países de la OCDE (2018), que solían traducirse en México como un rezago.

La EDN de 2013 estableció cinco objetivos cercanos a las prioridades marcadas por la OCDE, que trajeron a la mesa de discusión los retos nacionales con horizonte a 2020, desde una mirada transversal.

Es decir: mayor conectividad; inclusión y habilidades digitales; interoperabilidad e identidad digital; actualización del marco jurídico; y datos abiertos.

La segunda generación de la Estrategia Digital Nacional (2021-2014) se derivó del Programa Nacional de Desarrollo 2018-2014.

Esta EDN centró su atención en la digitalización, a través del proyecto prioritario que se llamó Internet para todos. (Atrás quedó el énfasis anterior en la Red NIBA, para centros educativos)

Fueron dos sus objetivos mayores, que no necesariamente incorporaban el espacio de la Inteligencia Artificial.

- Transformar la administración pública federal, mediante el uso y aprovechamiento de las Tecnologías de Información y Comunicación, para mejorar y transparentar los servicios gubernamentales que se otorgan a la ciudadanía”; e

- Incrementar la cobertura de Internet a todo el país para combatir la marginación y comunicar las zonas más pobres y alejadas, facilitando con ello su integración a las actividades productivas.

Iniciativas en espera de análisis en el Congreso mexicano

Un artículo escrito en 2024 por el investigador Ivan Vladimir Meza Ruiz (UNAM), ilustra las numerosas tentativas de regulación que ha habido en México en el lustro reciente. Afirma que desde 2020 se cuentan 58 iniciativas legislativas que han referido el término Inteligencia Artificial.

Aquí reduciremos esa larga lista a las propuestas factibles; las que al parecer podrían sobrevivir un tiempo más.

Entre las distintas propuestas que podrían mantenerse en estudio, en orden cronológico, mencionaremos primero la Iniciativa presentada por el senador Ricardo Monreal, en abril de 2024.

Este documento reconoce que en su elaboración “se tomaron como base” los precedentes normativos del Reglamento de la Unión Europea sobre Inteligencia Artificial.

Del mismo modo, admite que “por su identidad cultural con nuestro país”, incorporaron elementos del proyecto de ley que está en proceso en Chile, mismo que comentamos arriba.

Otra de las recientes propuestas fue presentada en abril de 2025, por las diputadas y diputados de los partidos Morena y Verde Ecologista de México. Se titula: Iniciativa con Proyecto de Decreto por el que se expide la Ley Federal para el Desarrollo Ético, Soberano e inclusivo de la Inteligencia Artificial.

Y la última de las propuestas se dio a conocer apenas el pasado 26 de diciembre. Por parte de los integrantes de una subcomisión de análisis, seguimiento y evaluación sobre la aplicación y desarrollo de la Inteligencia Artificial en México, del Senado. Ellos anunciaron que tendrían lista su propuesta de Ley IA durante el próximo mes febrero de 2026.

Los impulsores de esta propuesta anticiparon el acento que tendrá:

“El propósito no es únicamente proteger a la ciudadanía frente a los riesgos de la Inteligencia Artificial, sino también impulsar la innovación tecnológica para que México transite de ser un simple usuario de estas herramientas a un país desarrollador.” [Esperemos su avance. Véase El Independiente, 27 de diciembre, 2025].

Propuestas normativas relacionadas con la IA en México

Existen otras circunstancias que han incidido en México para mantener la atención en el vínculo entre derecho de autor y la IA. En especial, ante peticiones que han implicado una interpretación acerca del uso de la Inteligencia Artificial.

Por ejemplo, a principios de 2024 una persona solicitó al Instituto Nacional del Derecho de Autor (Indautor), de la Secretaría de Cultura del Gobierno de México, registrar a su nombre una obra digital llamada Avatar virtual, que había sido generada en una plataforma de IA.

Como Indautor se negó a registrarla (debido a que la Ley respectiva sólo contempla las obras de creación humana), el peticionario presentó una impugnación ante la Sala Especializada en Propiedad Intelectual, del Tribunal Federal de Justicia Administrativa.

No mucho tiempo después, en agosto de 2024, la Segunda Sala de la SCJN resolvió -por unanimidad de votos- negar el amparo solicitado.

La SCJN resolvió que “las obras creadas por Inteligencia Artificial (IA) no se pueden registrar como derechos de autor en México”. (Véase el caso en Indautor 2024). Y con ello creo precedente.

El doblaje de voz

Entre las iniciativas que han buscado atender demandas específicas de afectación de la Inteligencia Artificial en planos de actividad sectorial, mencionaremos la problemática planteada alrededor de los derechos de autor. En especial, sobre las técnicas de doblaje de voz.

En abril de 2025, el diputado del Partido del Trabajo de México, Santiago González, presentó una iniciativa en la Cámara de Diputados. Su propuesta encuentra su mayor justificación en lo que ha considerado como ausencia de legislación específica.

La iniciativa acentuó la problemática de afectación en el doblaje de voz. Y es que cada vez más -nos recordó en el documento- se emplean voces clonadas en las emisiones públicas.

Alertó ante la posibilidad de que las plataformas digitales en español mantengan esa tendencia, y sean éstas cada vez más utilizadas como herramientas habituales de doblaje.

Estima que en 2026 llegarán ya a 56% las emisiones mexicanas que emplean estos sistemas automatizados. Quizá nada se pueda hacer al respecto, por el momento.

Recuerda que el Parlamento Europeo cuenta ya con un Reglamento (de marzo de 2024) sobre inteligencia artificial, que establece un consentimiento informado y derechos para “los artistas cuya voz o imagen sea replicada por IA”. [ Véase la Iniciativa 24 de abril, 2024].

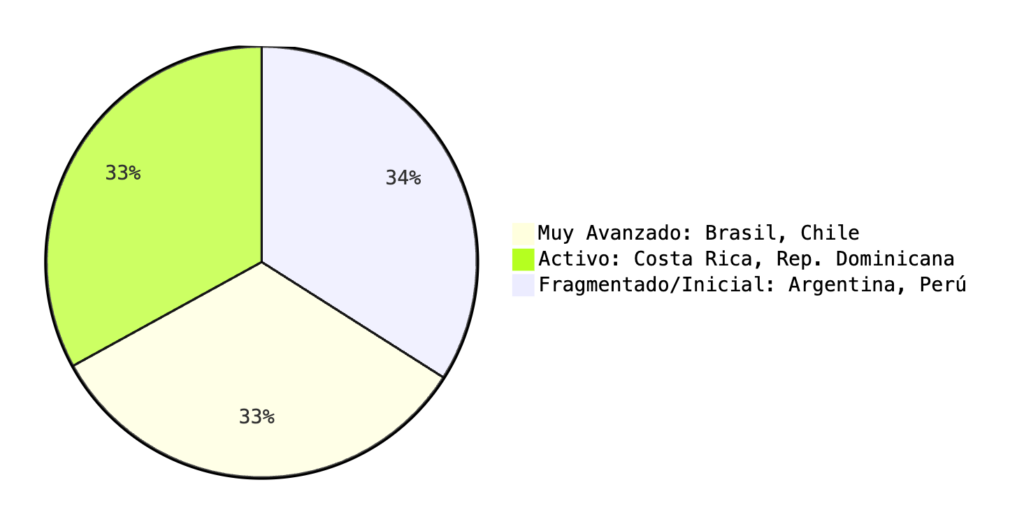

En suma, ¿qué países latinoamericanos muestran mayor avance regulatorio IA?

De acuerdo con el Índice Latinoamericano de Inteligencia Artificial (ILIA-CEPAL 2025):

“Una acelerada mejora de economías como Ecuador, Costa Rica, República Dominicana y Guatemala se destaca en esta versión, donde los países en estadios más tempranos de madurez se están poniendo al día a paso acelerado”. [Véase ILIA 2025].

Creemos que, en efecto, el desarrollo de proyectos de regulación latinoamericana se ha multiplicado de modo notable durante 2025. Aquí hemos presentado un primer resultado de ello y, en especial, la perspectiva hacia 2026.

Para finalizar, comentaremos con brevedad los avances registrados hasta hoy en dos de los cuatro países que refiere la CEPAL.

Costa Rica

Este país cuenta con una Estrategia Nacional de Inteligencia Artificial para el periodo 2024-2027. Durante 2025 mantuvo dos proyectos en estudio en la Asamblea Legislativa:

- el Proyecto de Ley de Regulación de la Inteligencia Artificial en Costa Rica; y

- el Proyecto para la Promoción Responsable de la IA en Costa Rica.

El primero se presentó en 2023 y se mejoró en 2024. Fue discutido en la Asamblea Legislativa. Y aunque ya logró un dictamen afirmativo, todavía no ha concluido su proceso legislativo, ni la aprobación consecuente.

Pese a que el texto de esta propuesta es un tanto general, lo significativo es que incorpora de manera temprana un artículo que busca estimular la innovación (el 17. Investigación y desarrollo).

Además, centra su atención -como la mayoría de los proyectos- en los derechos fundamentales y en la protección de datos personales. Desde luego, retoma los cuatro niveles de riesgo que, con base en el modelo europeo de 2021, se han expresado en diversos países.

La segunda propuesta es posterior. Es el Proyecto de Ley para la Promoción Responsable de la Inteligencia Artificial en Costa Rica, con dictamen afirmativo del 6 de marzo de 2025; aún sin ser aprobado.

Contiene un mayor énfasis en la gobernanza y en la regulación. Dispone la creación de la Comisión Interinstitucional para el Desarrollo de la Inteligencia Artificial (CIDIA), como organismo coordinador.

Presenta una amplia caracterización y expone los principios rectores que adoptará la IA en Costa Rica.

La propuesta, más que explorar caminos para la búsqueda de beneficios de la IA para los sectores costarricenses, parece mostrarla como algo ya consumado, y por ello anticipa la necesidad de colocar límites a los sistemas de IA.

Establece formas de aplicación y uso de la IA (no necesariamente de estímulo), en la salud, la educación y la investigación científica.

República Dominicana

La República Dominicana estableció su Estrategia Nacional de Inteligencia Artificial en 2023, con una hoja de ruta en el marco de la Política Nacional de Innovación a 2030.

En la actualidad, mantiene en estudio dos iniciativas en el Congreso: el Proyecto de ley que regula el desarrollo, implementación y uso de la inteligencia artificial en la República Dominicana (marzo de 2025) y el Proyecto de Ley Orgánica que regula los sistemas de Inteligencia Artificial (IA) en República Dominicana (mayo de 2025).

Conclusión

Recuperamos la idea planteada arriba, para el caso de nuestros países.

Estimamos que existe el riesgo de que los países emergentes se queden atrás (los latinoamericanos, en particular), si no imprimen una mayor cobertura sectorial y transversal a su política nacional sobre la IA (es decir, a su regulación).

Nos referimos al imperativo de impulsar una política y una regulación que esté en condiciones de asegurar la más amplia colaboración y sinergia (articulación). Con el trabajo de los científicos y tecnólogos, con las corporaciones que cuentan con infraestructura tecnológica y con el propio gobierno nacional, para la promoción y el desarrollo de los sistemas de IA.

La implicación que posee la necesidad de ampliar esa colaboración, coincide por cierto con la convicción manifiesta en el Informe ofrecido por ILIA-CEPAL para 2025:

“Desde la perspectiva de la integración latinoamericana, este despertar tecnológico también interpela a los países líderes a asumir un rol de cooperación más activo y estratégico, para evitar que la región profundice su histórica fragmentación digital y de capacidades técnicas.” [Véase el Índice Latinoamericano de Inteligencia Artificial, ILIA-CEPAL, 2025].

¿Qué opinión tienes al conocer todos estos procesos en marcha?

Fuentes:

Asamblea Legislativa de laRepública de Costa Rica. Comisión Permanente Especial Derechos Humanos. Ley para la Promoción Responsable de la Inteligencia Artificial en Costa Rica, Expediente núm. 23.919, Dictamen afirmativo de mayoría, 6 de marzo de 2025.

Biblioteca del Congreso de la Nación, Argentina. Dossier Legislativo: Inteligencia Artificial, Buenos Aires, año XIII, núm. 312, julio de 2025.

Bradford, Anu, «The Brussels Effect«, Northwestern University Law Review, Vol. 107, Núm. 1 (2012).

Bradford, Anu, The Brussels Effect: How the European Union Rules the World, Faculty Books (2020), Faculty Books. 232.

Cámara de Diputados. México. Propuesta que presentan las diputadas y diputados de los partidos Morena y Verde Ecologista de México: Iniciativa con Proyecto de Decreto por el que se expide la Ley Federal para el Desarrollo Ético, Soberano e inclusivo de la Inteligencia Artificial, México, abril de 2025.

Camara de Senadores. México. Iniciativa presentada por el senador Ricardo Monreal, Iniciativa con proyecto de decreto por el que se expide ley federal que regula la inteligencia artificial, México, abril de 2024.

Congreso Nacional. Brasil. Projeto de Lei de 2023 Dispõe sobre o uso da Inteligência Artificial, F/23833.90768-1, Senado federal, 17 de marzo, 2025.

Gaceta Parlamentaria, México. Iniciativa que reforma y adiciona diversas disposiciones de las Leyes Federales de Cinematografía; del Derecho de Autor, y del Trabajo, en materia de medidas de protección para las y los actores de doblaje en México frente al uso de inteligencia artificia. A cargo del diputado Santiago González Soto, del Grupo Parlamentario del PT. Año XXVIII, número 6768-II-4, jueves 24 de abril de 2025.

Kokotajlo, Daniel, Scott Alexander, Thomas Larsen, Eli Lifland y Romeo Dean, IA 2027, The AI Futures Project, 3 de abril, 2025.

Lagunes A., Martínez Y., Cárdenas C., De la Peña S., Mancilla D., Xilotl R., Sánchez O., Moguel A., Cárdenas J., Propuesta de agenda nacional de la Inteligencia Artificial para México (2024-2030). Alianza Nacional de Inteligencia Artificial (ANIA), mayo 2024.

Macías, Carlos, Una Secretaría de Estado para la ciencia mexicana, CIESAS (Documento interno de trabajo), 30 de agosto, 2024.

Meza Ruiz, Ivan Vladimir, El camino hacía una regulación de la IA en México, en Blog turing.iimas.unam.mx, 7 de julio, 2024.

Presidencia de la República. México. Acuerdo por el que se expide la Estrategia Digital Nacional 2021-2024, Diario Oficial de la Federación, 6 de septiembre, 2021.

Presidencia de la República. Perú. Ley de Protección de Datos Personales, Lima, Decreto Supremo Núm. 019-2017-JUS, publicado el 15 de setiembre de 2017.

Presidencia de la Repúbica. Perú. Decreto Supremo que aprueba el Reglamento de la Ley Nº 31814, Ley que promueve el uso de la inteligencia artificial en favor del desarrollo económico y social del país. Lima, Decreto Supremo Núm. 115-2025-PCM, publicado el 9 de setiembre de 2025.

Secretaría General de la Presidencia. Chile. Política Nacional de Ciencias, Tecnología, Conocimiento e Innovación, Santiago, octubre de 2020.

Secretaría General de la Presidencia. Chile. Mensaje de S. E. el Presidente de la República por el que inicia un Proyecto de Ley de Inteligencia Artificial, Santiago, 7 de mayo de 2024.

Secretaría General de la Presidencia. Chile. Proyecto de ley que Regula los sistemas de Inteligencia Artificial, Santiago, 7 de mayo de 2024.

Secretaría General de la Presidencia. Chile. Ley 21719. Regula la protección y el tratamiento de los datos personales y crea la agencia de protección de datos personales. Promulgada el 25 de noviembre de 2024; publicada el13 de diciembre de 2024.

Soto, Á., Durán, R., Moreno, A., Adasme, S., Rovira, S., Jordán, V. y Poveda, L. (Coords.) (2025). Índice Latinoamericano de Inteligencia Artificial (ILIA) 2025. Documentos de Proyectos (LC/TS.2025/68). Comisión Económica para América Latina y el Caribe y Centro Nacional de Inteligencia Artificial.

Imagen de la portada: Gemini 3.

Carlos Macías.

ORCID: 0000-0001-8440-5256

Resumen de este Artículo. Generado por Anthropic Claude 4.5 Sonnet. [5 de enero, 2025].

📌 Fechas Críticas 2025-2026

🇧🇷 Brasil – Líder Regional

- 2020-11: Ley 21/2020 aprobada por Senado

- 2023: PL 2338/2023 presentado (70,000 participantes en consulta)

- 2024-2025: Tramitación en Cámara de Diputados

- 2026: Entrada en vigor proyectada ✅

Características:

- 2 niveles de riesgo (excesivo y alto)

- Autoridad: ANPD (creada 2018)

- Prioriza: persona humana, derechos humanos, desarrollo sostenible

🇨🇱 Chile – Protección de Datos

- 2024-03: Proyecto de Ley presentado

- 2024-12-13: Ley crea Agencia Protección Datos Personales

- 2026-12-01: Agencia entra en operación ✅

Características:

- 4 niveles de riesgo (modelo europeo completo)

- Enfoque: protección datos + derechos fundamentales

- Evaluación continua e iterativa

🇨🇷 Costa Rica – Doble Vía

- 2024: Estrategia Nacional 2024-2027

- 2023-2025: Proyecto Regulación IA (dictamen afirmativo)

- 2025-03: Proyecto Promoción IA (dictamen 6 marzo)

Características:

- Artículo 17: Investigación y desarrollo

- CIDIA: Comisión Interinstitucional

- Balance entre regulación y promoción

🇩🇴 República Dominicana

- 2023: Estrategia Nacional hasta 2030

- 2025-03: Proyecto desarrollo/implementación IA

- 2025-05: Proyecto Ley Orgánica sistemas IA

Características:

- 2 proyectos simultáneos en Congreso

- Enfoque: innovación dentro de Política 2030

🇦🇷 Argentina – Mosaico Normativo

- 2024: Marco regulatorio no aprobado

- 2025: Propuesta oposición (Admin. Pública Nacional)

- Normativa vigente: Disposiciones aisladas

Vigentes:

- Disposición 2/23: Recomendaciones IA fiable

- Resolución 161/23: Transparencia y datos

- Ley 27.736 (2023): Violencia género digital

- Resoluciones 428/24 y 710/24: UIAAS (Seguridad)

🇵🇪 Perú – Base de Datos

- 2017: ANPD creada

- 2024-2025: Estrategia Nacional en desarrollo

- Sin proyecto de ley específico aún

🔑 Hallazgos Clave del Artículo

Modelo Dominante: Europeo Basado en Riesgo

La mayoría de países adoptan (o adaptan) el modelo de la Comisión Europea 2021

Brasil lo modifica a 2 niveles:

- ⛔ Riesgo Excesivo (prohibido): manipulación subliminal, scoring social, explotación vulnerabilidades

- ⚠️ Riesgo Alto: salud, transporte, identificación biométrica, selección personal

Chile mantiene 4 niveles:

- ⛔ Inaceptable (prohibido)

- ⚠️ Alto

- ⚡ Medio

- ✅ Bajo

🎨 Nivel de Madurez Legislativa

Esquema resumido de este Artículo. Generado por Gemini 3. [5 de enero, 2025].

| Dimensión (en países emergentes) | Enfoque de Contención (Defensivo) | Enfoque de Soberanía (Proactivo) |

| Meta Principal | Mitigar riesgos y evitar discriminación. | Fomentar la creación de tecnología propia. |

| Inspiración | Reglamento de la Unión Europea. | Modelos híbridos con incentivos a la industria. |

| Papel del Estado | Fiscalizador y protector de datos. | Coordinador de sinergias ciencia-empresa-gobierno nacional. |

| Riesgo | Rezago tecnológico y dependencia. | Posibles brechas éticas si no hay control. |