polifonIA.org | Carlos Macías (CIESAS). La mayoría de los esfuerzos latinoamericanos para regular la Inteligencia Artificial se centran en el Enfoque de riesgo IA, que se planteó en Europa desde la primera etapa de su Ley IA (2021-2024).

Hace algunas semanas, presentamos aquí una revisión de las iniciativas latinoamericanas en curso y de los avances de regulación en Europa, China y Estados Unidos. En cada bloque geopolítico se percibe un claro contraste.

- Una confusión frecuente

- ¿Por qué importa precisar el enfoque de la regulación IA?

- ¿Cuál es el estado actual de la regulación latinoamericana IA?

- Predominio de un enfoque en América Latina

- El objetivo de las leyes IA debe dirigirse a los sistemas IA

- La aplicación gradual de la Ley IA

- Simplificar las leyes IA. No parece funcional "una" sola Ley IA nacional

- ¿Quién aplica los términos de la Ley IA europea?

- The Brussels Effect y el Enfoque de Riesgo

- El enfoque que llegó para quedarse

- Los niveles del Enfoque de riesgo europeo

- Nivel de Riesgo inaceptable

- Nivel de Riesgo alto

- Casos de uso clasificados como de Riesgo alto

- Obligaciones para comercializar Sistemas IA en el nivel Riesgo alto

- ¿Quién supervisa el cumplimiento de las Obligaciones de los Sistemas IA en el nivel Riesgo alto?

- Nivel de Riesgo que se atiende al cumplir obligaciones de transparencia

- Nivel de Riesgo mínimo o nulo

- Conclusión

- 1

- 2

Una confusión frecuente

Existen en el mundo numerosas Declaraciones IA de ética y de buenas prácticas, al menos desde 2021 y muy probablemente anteriores.

Por principio, debe considerarse que casi todas las leyes IA en el mundo aún se encuentran en proceso de diseño (y de rediseño), incluidas las de Europa y las (Órdenes Ejecutivas) de los Estados Unidos.

Por el momento, no hay acuerdo general en el mundo sobre el enfoque idóneo para regular la Inteligencia Artificial.

En el extremo, hay Declaraciones IA de ética y buenas prácticas que le atribuyen a la Inteligencia Artificial la capacidad para «ampliar derechos, nunca reducirlos».

Casi sobra apuntar que la única entidad que podría «ampliar o reducir» los derechos individuales, es el Estado nacional (su Poder Legislativo).

Y que la Inteligencia Artificial -vista como lo que es: una creciente confluencia tecnológica y lingúística colectiva en nuestro tiempo– ha emergido y se reproducirá con amplitud dentro del marco de interacción cotidiana entre la sociedad, las corporaciones privadas y las instituciones públicas.

En suma, cualquier Declaración IA de ética y de buenas practicas siempre será una guía para adherirse de manera voluntaria. En cambio, una ley federal de IA siempre será una norma jurídica de carácter obligatorio para cualquier país.

Una Ley preceptúa y obliga a los habitantes de un país. Una Declaración aconseja e invita a las personas.

De ahí la gran importancia de generar con seriedad una buena ley IA para cada país.

¿Por qué importa precisar el enfoque de la regulación IA?

En el caso de Estados Unidos, las Órdenes Ejecutivas emitidas hasta ahora por la Administración del Presidente Donald Trump, privilegian el Enfoque de innovación. Pero también el control federal. Si se juzgara por su énfasis, diríamos que las Órdenes Ejecutivas anteponen la hegemonía federal frente a las legislaciones estatales de fomento de la IA.

Hasta ahora, Estados Unidos ha eludido proponer un Enfoque basado en riesgo de la IA.

En cambio, la ruta de trabajo creada para el viejo continente la estableció el Parlamento Europeo (y la Comisión Europea), desde su Reglamento de 2021.

Y se ha consolidado en su forma actual, como Ley IA («Act AI» de 2024).

La ley IA de Europa, con desarrollo, ajustes y proyección hasta 2031, se centra en el Enfoque de riesgo. En ese plano han trabajado con consistencia y gradualidad.

La Ley IA europea no se dirige para su aplicación a las expresiones u opiniones de las personas, de la ciudadanía, al valerse de la IA. Sus niveles de riesgo se dirigen a los Sistemas IA y a los implementadores (personas físicas y morales).

Cuentan con un cronograma ajustable y una estrategia conjunta de gobernanza. Han avanzado en una norma flexible, por lo que -se prevé- estará preparada para el futuro.

Quizá con el tiempo emerjan para la Unión Europa algunas disyuntivas difíciles, desde nuestro punto de vista: las que se derivan de las sucesivas etapas para aplicar las estrategias y el marco completo de la Ley IA.

En lo personal, vemos que las etapas por venir en Europa lucen demasiado complejas, insertas en tiempos de alternancia institucional en el viejo continente.

En seguida fundamentaremos esta impresión.

Grado de avance de iniciativas de ley de IA, por país

Legislación sobre inteligencia artificial · Panorama global 2026

Iniciativas de Ley de IA por país

Grado de avance

Pasa el cursor sobre los países

Fuentes: IAPP Global AI Law & Policy Tracker (feb. 2026); Comisión Europea; OneTrust Outlook 2026; Eversheds-Sutherland Global AI Bulletin (abr. 2026); NCSL; Ministerio de Ciencia, TIC y Futuro de Corea; MIC de Japón.

Mapa interactivo y tridimensional: diseñado por Claude Opus 4.7, de Anthropic.

¿Cuál es el estado actual de la regulación latinoamericana IA?

El apremio por regular la IA, al que han estado sometidos los poderes públicos en América Latina, desde hace un par de años, ha sido sofocante.

Ello ha transcurrido a tono con el crecimiento y la masificación de los modelos de lenguaje ampliado (LLMs).

La expectativa creada para normar la IA en América Latina, estimulada por sectores de interés, ha sido creciente.

Suele apurarse a los Congresos y/o a las Asambleas Nacionales para contar con una regulación de IA.

Se espera una regulación que pueda cubrir los ámbitos que han resultado más sensibles: el educativo, el laboral, el jurídico, el de diseño, el de sistemas, el editorial, el comunicativo, el corporativo y los que corresponden a los derechos de autoría y doblaje.

Pero debe aceptarse: detrás de tal presión se agazapa una sombra de interés adverso hacia los nuevos circuitos y ambientes de la «expresión social». Una «expresión social» que se apropia con agilidad de los recursos de la tecnología, del diseño y de los lenguajes, para potenciar sus reacciones en las redes.

Por ello, los actores políticos de todos los colores suelen confundir y, a veces fusionar, el empleo creciente de la IA en las plataformas con las manifestaciones de dicha apropiación social en las redes.

Les desafía el uso empoderado con que se pueden expresar las personas, y desconfían de la multiplicación de los códigos de lenguaje. En especial, los lenguajes gráficos.

No debe extrañar, por ello, que los Congresos y las Asambleas de los países latinoamericanos hayan avanzado con el espejo pre elaborado que les ofrece Europa y su precursora Ley IA.

La mayoría de los parlamentos en los países latinoamericanos se decantan, en sus iniciativas, por seleccionar el Enfoque de riesgo. El mismo que Europa ha priorizado desde el desarrollo inicial de su Ley, en 2021.

Predominio de un enfoque en América Latina

Con todo, resulta alentador ver Congresos latinoamericanos que cuentan con versiones de iniciativas basadas en Enfoque de riesgo, pero que han adoptado una modalidad híbrida.

Muestran una notable apertura y respaldo a la innovación. Y dan protagonismo a Consejos Asesores Técnicos, bajo la conducción de los Ministerios de Ciencia y Tecnología. (La iniciativa chilena es un buen ejemplo).

Existen, en cambio, otras iniciativas guiadas por el apremio de legislar IA. Buscan imprimir un enfoque político a su iniciativa de IA (no público, como se espera).

Parecen dirigir el contenido de su iniciativa al ámbito moral y conductual de las redes sociales. Como réplica a la propagación multimodal de la opinión individual -con renovadas alternativas tecnológicas-. Permanecen así distantes, en el fondo, del Enfoque de riesgo europeo.

Pero quizá el verdadero riesgo pueda recaer en aquellos ambientes nacionales que no gozan por completo de instituciones democráticas arraigadas. Que cuentan con insuficientes condiciones institucionales para acoger la diversidad de idearios y de proyectos.

El objetivo de las leyes IA debe dirigirse a los sistemas IA

Reiteramos la entidad objetivo. La Ley IA de Europa no se aplica a las expresiones y opiniones que puedan valerse de la IA. Está dirigida centralmente a los sistemas IA, en sus cuatro niveles de riesgo.

Esto es, no está habilitada para pronunciarse acerca de la conveniencia (o no) de publicar un meme generado por IA, con objeto de ser difundido en las redes sociales.

La aplicación gradual de la Ley IA

La Ley Europea es de naturaleza progresiva. Proyecta que a su culminación, el 2 de agosto de 2031, la Comisión Europea llevará «a cabo una evaluación de la aplicación del presente Reglamento e informará al respecto al Parlamento Europeo, al Consejo y al Comité Económico y Social Europeo».

Por ello, la Comisión Europea reconoce que su gradual desarrollo habrá de ser necesariamente enmendable.

Comencemos por acentuar que La Ley de IA de Europa «no se aplica a todas las soluciones de IA, sino solo a aquellas que cumplen la definición de sistema de IA«. (Artículo 3, 1).

El Parlamente Europeo reconoce que «la mayoría de los sistemas de IA presentan riesgos mínimos o nulos y pueden contribuir a resolver muchos problemas sociales». Pero ciertos sistemas de IA podrían generar riesgos «que debemos abordar para evitar resultados indeseables«.

Adapta su aplicación a los niveles de riesgo. El riesgo mayor, que merece más atención es el que se define como «inaceptable»: para la salud, la seguridad y los derechos constitucionales.

Colocan como prioridad la protección a la no discriminación «puntuación social», la seguridad (control fronterizo, vehículos autónomos).

Definitivamente, sancionar un meme en redes sociales con IA, no parece interesar a la Ley IA de Europa.

Simplificar las leyes IA. No parece funcional «una» sola Ley IA nacional

Tan progresiva e intrincada es la Ley IA de Europa (2024) que, para ser aplicada en la actualidad, se le ha añadido una propuesta de retoque en 2026. Vamos a citar lo más relevante:

- «El Paquete Digital sobre Simplificación propone enmiendas para simplificar la implementación de la Ley de IA y garantizar que las normas sigan siendo claras, sencillas y favorables a la innovación.»

- «La Comisión propone ajustar el plazo de aplicación de las normas de alto riesgo a un máximo de 16 meses. Esto garantiza que las normas se apliquen cuando las empresas cuenten con las herramientas de apoyo adecuadas para facilitar su implementación, como por ejemplo, las normas.»

La Comisión Europea está proponiendo, en estos días, enmiendas específicas a su Ley de IA.

En marzo de 2026, el Parlamento Europeo aún discutía la propuesta de simplificación. Se reconsideraron las fechas de aplicación para los sistemas de más riesgo y el veto de los desnudos falsos. (Véase ambos temas en el sitio del Parlamento Europeo).

¿Quién aplica los términos de la Ley IA europea?

La Ley IA europea confiere al comité científico el papel preponderante «a la hora de garantizar la correcta aplicación de la Ley».

Éste podrá emitir una alerta a la Oficina de IA en caso de que «se sospeche que un modelo de IA general (GPAI) plantea un riesgo concreto e identificable a escala de la Unión Europea» (artículo 90).

Según el artículo 18, para poder emitir cualquier alerta cualificada, se requiere -como mínimo- la mayoría simple de los miembros del comité científico.

La aplicación de la Ley IA europea reserva un conjunto de mecanismos para garantizar la imparcialidad de la decisión. Cuando el comité científico envíe la «alerta cualificada» a la Oficina de IA, ésta aún contará con un par de semanas para decidir si ejerce sus facultades.

Se trata, de acuerdo con la Comisión Europea, de «un procedimiento ágil, [que] hace que el mecanismo de las alertas cualificadas resulte especialmente útil» en el marco de la aplicación de la Ley de IA.

Revisemos en breve la huella europea en América Latina.

The Brussels Effect y el Enfoque de Riesgo

Todavía hace seis años, la profesora Anu Bradford, de la Escuela de Derecho de Columbia, aludía a la fuerte prevalencia de Europa.

Su libro de 2020 acudió al actual papel influyente de Europa. Lo tituló de nuevo The Brussels Effect: How the European Union Rules the World, Faculty Books (2020).

(Recuérdese que a raíz de su artículo de 2012 -«The Brussels Effect»-, Bradford se volvió una autora de referencia. Como se sabe, la sede de la Unión Europea se ubica en Bruselas).

Anu Bradford definió -en 2020- a Europa como…

«una superpotencia influyente que moldea el mundo a su imagen.«

«Al promulgar regulaciones que moldean el entorno empresarial internacional, eleva los estándares a nivel mundial, conduce a una notable europeización de muchos aspectos importantes del comercio global.«

«La UE ha logrado dar forma a las políticas en áreas como la privacidad de los datos, la salud y seguridad del consumidor, la protección del medio ambiente, la lucha contra la competencia y el discurso de odio en línea.”

[Véase la descripción de la obra, en Columbia Law School].

Por ahora, la visión de Bradford es convergente con la manera en que Europa ha marcado la agenda IA -con sus ejes de regulación-, para ayudar a modelar las propuestas en los países emergentes.

El enfoque que llegó para quedarse

Vale señalar que la ruta de trabajo para regular la IA inició en Europa desde 2021. En ese momento, la Comisión Europea culminó una propuesta legislativa para considerar el Reglamento General de IA.

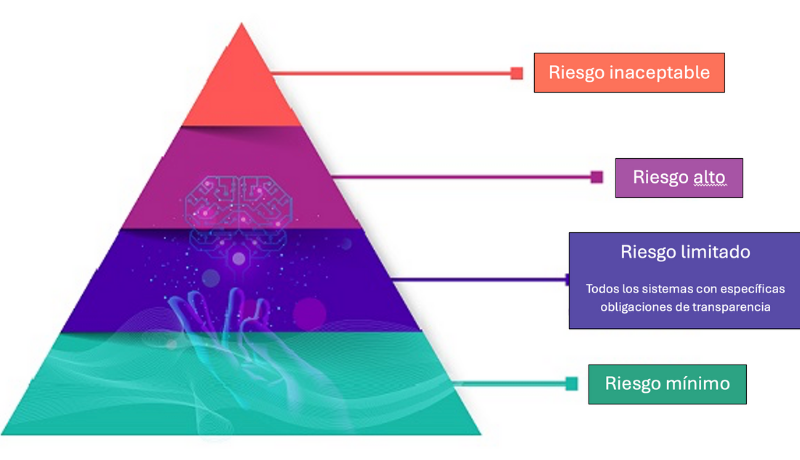

Ahí nació justo el Enfoque basado en niveles de riesgo:

- 1. Nivel de Riesgo inaceptable.

- 2 .Nivel de Riesgo alto.

- 3. Nivel de Riesgo que se atiende al cumplir obligaciones de Transparencia.

- 4. Nivel de Riesgo mínimo o nulo. (Para este nivel, no se contempla legislación).

Tres años más tarde, en mayo de 2024, el Consejo de la Unión Europea decidió su aprobación.

El Enfoque de niveles de riesgo no está dirigido en esencia a los ciudadanos. Está dirigido a los sistemas IA, que pueden ser auspiciados por personas físicas o morales. [Véase Comisión Europea].

Los niveles del Enfoque de riesgo europeo

Nivel de Riesgo inaceptable

El Riesgo inaceptable se específica en el artículo 5 de la Ley IA de la Comisión Europea. Es una legislación enfocada desde la Comisión Europea hacía los Sistemas IA, para su cumplimiento. Busca asumir los derechos de la ciudadanía ante los Sistemas IA.

Para afrontar las situaciones de Riesgo inaceptable, se colocan estas taxativas a los Sistemas IA. La prohibición se hace extensiva a los canales de comercialización:

- Prohíbe técnicas subliminales que puedan precipitar decisiones en usuarios;

- Prohíbe explotar vulnerabilidades de usuarios. (Por discapacidad o condición socioeconómica; se entiende también que por factores educativos);

- Restringe clasificar personas físicas por puntuación social: para prevenir tratos desfavorables.

- Restringe evaluar usuarios para predecir riesgos en comisión de delitos. (Se exceptúa cuando se colabora para evaluar personas dedicadas a actividades delictivas).

- Prohíbe crear o ampliar bases de datos de reconocimiento facial, a través de la extracción no selectiva de imágenes faciales. (Sean de Internet o grabaciones en circuito cerrado TV).

- Suprime el uso de IA para inferir emociones de una persona física en ámbitos laborales y educativos. (Se exceptúa cuando debe emplearse por causas médicas o de seguridad);

- Suprime la utilización de sistemas biométricos IA que puedan categorizar a las personas físicas. (Basados en datos que infieran: raza, opiniones políticas, afiliación sindical, creencias religiosas, vida u orientación sexual).

- Prohíbe utilizar Sistemas IA de identificación biométrica a distancia «en tiempo real», en accesos públicos con fines policiales. (A menos que sea para buscar víctimas de secuestros, trata o explotación sexual).

- Establece que usar Sistemas IA para identificación biométrica a distancia «en tiempo real», en accesos públicos con fines policiales, estará sujeta a autorización previa. Ésta deberá ser concedida por una autoridad judicial o administrativa independiente.

[Véase el Artículo 5 de la Ley IA].

Nota: el nivel de Riesgo inaceptable inició vigencia en febrero, 2025.

Nivel de Riesgo alto

El nivel de Riesgo alto está constituido por ciertos casos de uso asociados con las obligaciones de los Sistemas IA. Se trata de aplicaciones que podrían acarrear riesgos para la salud, la seguridad o los derechos fundamentales de las personas.

Estos casos de uso se encuentran contemplados en el Artículo 6 de la Ley IA de la Comisión Europea. El listado de recursos definidos como de Riesgo alto podría desconcertar a los lectores de polifonIA.org. Porque se trata de componentes de Sistemas IA que son de uso casi habitual en las actividades institucionales.

Por ello recomendamos mucho asociarlos con el listado que se presenta después, titulado «Obligaciones estrictas para comercializar Sistemas IA«, porque impone el cumplimiento de ciertas directivas para su implementación.

Casos de uso clasificados como de Riesgo alto

- «Componentes de seguridad de IA en infraestructuras críticas (por ejemplo, el transporte), cuyo fallo podría poner en riesgo la vida y la salud de los ciudadanos.

- Soluciones de IA utilizadas en instituciones educativas que pueden determinar el acceso a la educación y el rumbo de la vida profesional de una persona (por ejemplo, la calificación de exámenes).

- Componentes de seguridad de productos basados en inteligencia artificial (por ejemplo, la aplicación de la IA en la cirugía robótica).

- Herramientas de IA para el empleo, la gestión de trabajadores y el acceso al autoempleo (por ejemplo, software de clasificación de CV para la contratación).

- Determinados casos de uso de la IA utilizados para dar acceso a servicios públicos y privados esenciales. (Por ejemplo, puntuación crediticia niega a los ciudadanos la oportunidad de obtener un préstamo).

- Sistemas de IA utilizados para la identificación biométrica remota, el reconocimiento de emociones y la categorización biométrica. (Por ejemplo, un Sistema IA para identificar retroactivamente a un ladrón).

- Casos de uso de los Sistemas IA en la aplicación de la ley que pueden interferir con los derechos fundamentales de las personas. (Por ejemplo, la evaluación de fiabilidad de las pruebas).

- Casos de uso de la IA en la gestión de la migración, el asilo y el control de fronteras. (Por ejemplo, el examen automatizado de solicitudes de visado).

- Soluciones de Sistemas IA utilizadas en la administración de justicia y los procesos democráticos. (Por ejemplo, soluciones de IA para preparar resoluciones judiciales).

- Sistemas IA destinados a influir en el resultado de una elección o referéndum. O en el comportamiento electoral de las personas físicas al ejercer su derecho al voto. Se exceptúan sistemas de IA cuyos resultados no afectan a las personas físicas, como organizar, optimizar o estructurar campañas desde un punto de vista administrativo o logístico.»

Obligaciones para comercializar Sistemas IA en el nivel Riesgo alto

Como hemos señalado arriba, los 10 casos enlistados que podrían funcionar con los Sistemas IA en este nivel de Riesgo alto, requerirán el cumplimiento de un conjunto de «Obligaciones para comercializar Sistemas IA«, antes de ser comercializadas:

- «Sistemas adecuados de evaluación y mitigación de riesgos.

- Alta calidad de los conjuntos de datos que alimentan el sistema para minimizar los riesgos de resultados discriminatorios.

- Registro de la actividad para garantizar la trazabilidad de los resultados.

- Documentación detallada que proporcione toda la información necesaria sobre el sistema y su finalidad para que las autoridades evalúen su cumplimiento.

- Información clara y adecuada al implementador.

- Medidas adecuadas de supervisión humana.

- Alto nivel de robustez, ciberseguridad y precisión.»

¿Quién supervisa el cumplimiento de las Obligaciones de los Sistemas IA en el nivel Riesgo alto?

Debido a que es importante clarificar la vía para el cumplimiento de estas obligaciones para los Sistemas IA comercializados, en esta sección expondremos los filtros de supervisión y autorización.

La Ley IA contempla autoridades multinivel, que descansan en el plano nacional. De ahí que hayamos aludido al inicio de este artículo a su complejidad operativa y a la conveniencia de su concepción para un avance gradual.

En el nivel mayor, la Comisión Europea y la Oficina de IA colaboran de manera estrecha con las autoridades nacionales competentes, encargadas de supervisar la implementación y la aplicación de la Ley de IA de Europa en el nivel nacional.

En el plano nacional, la Ley IA de Europa dispuso la designación de «autoridades nacionales competentes». Son dos:

- Las autoridades de vigilancia del mercado. Ellas supervisan el cumplimiento de las normas emitidas a los sistemas de IA (Tanto las prohibiciones (nivel Riesgo inaceptable-, como de nivel Riesgo alto).

- Las autoridades notificantes. Ellas designan y supervisan a los organismos notificados, que son organismos independientes que llevan a cabo la evaluación de la conformidad previa a la comercialización.

En teoría, según la Ley IA, al menos una «autoridad de vigilancia» y una «autororidad notificante» por cada país debieron haber sido designadas antes del 2 de agosto de 2025. Van avanzando en forma gradual. No todas han concluido el proceso de designación en abril de 2026.

[Todo lo anterior se puede revisar en el Artículo 6 , 20 y 30, y en la sección: «Por qué necesitamos normas sobre IA«].

Nota: el nivel de Riesgo alto iniciará su vigencia en dos etapas: a partir de agosto de 2026 y de agosto de 2027.

Nivel de Riesgo que se atiende al cumplir obligaciones de transparencia

- «La Ley de IA introduce obligaciones de divulgación específicas para garantizar que las personas estén informadas cuando sea necesario para preservar la confianza. Por ejemplo, al usar sistemas de IA como los chatbots, las personas deben ser conscientes de que están interactuando con una máquina para que puedan tomar una decisión informada.»

- «Además, los proveedores de IA generativa deben garantizar que el contenido generado por IA sea identificable. Asimismo, cierto contenido generado por IA debe estar etiquetado de forma clara y visible. Etiquetado en forma clara y visible al tratarse de deepfakes. y los textos publicados con el fin de informar al público sobre asuntos de interés público.»

En este nivel de riesgo, relativo a las obligaciones de Transparencia, se aprecia que Ley IA de la Comsión Europea no se dirige para su aplicación a las expresiones, opiniones u obras de las personas, de la ciudadanía. Se dirigen en esencia a los Sistemas IA y a los implementadores (personas físicas y morales).

| Tipo de sistema IA | Obligación | Excepción |

| Sistemas de IA que generan deepfakes. | El responsable de la implementación debe informar a los usuarios que el contenido ha sido producido o modificado artificialmente. | Obras artísticas o creativas donde la transparencia no obstaculiza el disfrute. Sistemas de IA autorizados para fines policiales |

Nota: el nivel de Riesgo que implica obligaciones de transparencia iniciará su vigencia en agosto de 2026.

Nivel de Riesgo mínimo o nulo

El articulado de la Ley IA Europea no abunda con amplitud acerca de los sistemas IA de Riesgo mínimo o nulo. Se aprecia en la base de la pirámide que hemos insertado arriba (en español), con su fuente original. Pero el hecho es que los Sistemas IA de este nivel no están sujetos a obligaciones legales, ni tampoco a restricciones.

Vamos a apuntar que -para la Ley IA europea- los LLMs que empleamos todos los días parecen entrar en esta categoría: «La gran mayoría de los sistemas de IA que se utilizan actualmente en la UE -señala la web oficial de Unión Europea- entran en esta categoría. Esto incluye aplicaciones como videojuegos con IA o filtros de spam.» [Véase la sección: ¿Por qué necesitamos normas sobre la IA?].

Conclusión

La Inteligencia Artificial debe verse como el resultado de una amplia confluencia tecnológica y lingüística, que cubrirá de modo transversal a una buena parte de las actividades humanas.

Diseñar una sola ley que pretenda cubrir toda la proyección transversal de la IA en los numerosos espacios de actuación y quehacer humanos, podría ser un trabajo sin fin (y generar roces desgastantes en los círculos de opinión).

1

La realidad aconseja crear una ruta de trabajo, con base en las mayores experiencias nacionales. El reto habrá de ser atender en el plano normativo, con gradualidad, el avance de los distintos componentes y usos de la IA, en los espacios de mayor incidencia.

La tendencia de la regulación IA en Europa y en los Estados Unidos marca que la prevención del riesgo ante la IA no está enfocada a los ciudadanos. Se orienta hacia los Sistemas IA y los implementadores, que pueden ser personas físicas y morales.

Es decir, no son legislaciones enfocadas desde los Estados hacía la ciudadanía, para su cumplimiento. De hecho, sus preceptos buscan garantizar a plenitud los derechos de la ciudadanía ante los sistemas de IA.

2

El desarrollo gradual de la Ley de Europa, muestra cierto rezago. Se había prometido que para febrero de 2026 la Comisión Europea publicaría las directrices para el nivel 3. Pero es probable ello ocurra hasta abril o mayo de 2026. Las directrices urgen para cumplir con la aplicación total de la Ley que se prevé para el 2 de agosto de 2026.

¿Qué dice la Ley de IA europea de 2024 sobre la publicidad política electoral?

Estipula que las obligaciones de la Ley IA «no afectan al contenido de los anuncios políticos, ni a otros aspectos de la publicidad política, como la conducción de las campañas políticas, que se rigen por las normas nacionales».

Tampoco cubre, comprensiblemente, los contenidos «bajo responsabilidad editorial», ni «las opiniones expresadas a título personal». (Véanse «Resúmenes de la legislación de la UE«).

Llegados a este punto, ¿qué enfoque acentuarías en tu país: el Enfoque de innovación, el Enfoque de riesgo o un Enfoque híbrido?

Fuentes:

Asamblea Legislativa de la República de Costa Rica. Comisión Permanente Especial Derechos Humanos. Ley para la Promoción Responsable de la Inteligencia Artificial en Costa Rica, Expediente núm. 23.919, Dictamen afirmativo de mayoría, 6 de marzo de 2025.

Biblioteca del Congreso de la Nación, Argentina. Dossier Legislativo: Inteligencia Artificial, Buenos Aires, año XIII, núm. 312, julio de 2025.

Bradford, Anu, «The Brussels Effect«, Northwestern University Law Review, Vol. 107, Núm. 1 (2012).

Bradford, Anu, The Brussels Effect: How the European Union Rules the World, Faculty Books (2020), Faculty Books. 232.

Cámara de Diputados. México. Propuesta que presentan las diputadas y diputados de los partidos Morena y Verde Ecologista de México: Iniciativa con Proyecto de Decreto por el que se expide la Ley Federal para el Desarrollo Ético, Soberano e inclusivo de la Inteligencia Artificial, México, abril de 2025.

Cámara de Senadores. México. Iniciativa presentada por el senador Ricardo Monreal, Iniciativa con proyecto de decreto por el que se expide ley federal que regula la inteligencia artificial, México, abril de 2024.

Congreso Nacional. Brasil. Projeto de Lei de 2023 Dispõe sobre o uso da Inteligência Artificial, F/23833.90768-1, Senado federal, 17 de marzo, 2025.

Endal, Oystein; Andrea Vcric; Sidsel Nag; Nick Malter; y Daylan Araz, “Modificación de la IA con arreglo a la Ley de IA de la UE: Lecciones prácticas sobre clasificación y cumplimiento”, en EU Artificial Intelligence Act, 5 de Noviembre, 2025.

EU Artificial Intelligence Act, “Resumen de alto nivel de la Ley AI”, 27 Feb, 2024 (Actualizado el 30 de mayo, de acuerdo con la versión Corrigendum de la Ley AI).

Filipova, I. A., “Legal Regulation of Artificial Intelligence: Experience of China”, Journal of Digital Technologies and Law, Vol. 2, núm.1, 2024.

Gaceta Parlamentaria, México. Iniciativa que reforma y adiciona diversas disposiciones de las Leyes Federales de Cinematografía; del Derecho de Autor, y del Trabajo, en materia de medidas de protección para las y los actores de doblaje en México frente al uso de inteligencia artificia. A cargo del diputado Santiago González Soto, del Grupo Parlamentario del PT. Año XXVIII, número 6768-II-4, jueves 24 de abril de 2025.

Kokotajlo, Daniel, Scott Alexander, Thomas Larsen, Eli Lifland y Romeo Dean, IA 2027, The AI Futures Project, 3 de abril, 2025.

Lagunes A., Martínez Y., Cárdenas C., De la Peña S., Mancilla D., Xilotl R., Sánchez O., Moguel A., Cárdenas J., Propuesta de agenda nacional de la Inteligencia Artificial para México (2024-2030). Alianza Nacional de Inteligencia Artificial (ANIA), mayo 2024.

Meza Ruiz, Ivan Vladimir, El camino hacia una regulación de la IA en México, en Blog turing.iimas.unam.mx, 7 de julio, 2024.

Official Journal of the European Union, “Regulation (EU) 2024/1689 of the European Parliament and of the Council of 13 June 2024”, 12 de julio, 2024.

Presidencia de la República. México. Acuerdo por el que se expide la Estrategia Digital Nacional 2021-2024, Diario Oficial de la Federación, 6 de septiembre, 2021.

Presidencia de la República. Perú. Ley de Protección de Datos Personales, Lima, Decreto Supremo Núm. 019-2017-JUS, publicado el 15 de setiembre de 2017.

Presidencia de la República. Perú. Decreto Supremo que aprueba el Reglamento de la Ley Nº 31814, Ley que promueve el uso de la inteligencia artificial en favor del desarrollo económico y social del país. Lima, Decreto Supremo Núm. 115-2025-PCM, publicado el 9 de setiembre de 2025.

Secretaría General de la Presidencia. Chile. Política Nacional de Ciencias, Tecnología, Conocimiento e Innovación, Santiago, octubre de 2020.

Secretaría General de la Presidencia. Chile. Mensaje de S. E. el Presidente de la República por el que inicia un Proyecto de Ley de Inteligencia Artificial, Santiago, 7 de mayo de 2024.

Secretaría General de la Presidencia. Chile. Proyecto de ley que Regula los sistemas de Inteligencia Artificial, Santiago, 7 de mayo de 2024.

Secretaría General de la Presidencia. Chile. Ley 21719. Regula la protección y el tratamiento de los datos personales y crea la agencia de protección de datos personales. Promulgada el 25 de noviembre de 2024; publicada el 13 de diciembre de 2024.

Soto, Á., Durán, R., Moreno, A., Adasme, S., Rovira, S., Jordán, V. y Poveda, L. (Coords.) (2025). Índice Latinoamericano de Inteligencia Artificial (ILIA) 2025. Documentos de Proyectos (LC/TS.2025/68). Comisión Económica para América Latina y el Caribe y Centro Nacional de Inteligencia Artificial.

Trump, Donald, “Statement by President-elect Donald J. Trump Announcing the Appointment of David O. Sacks as White House A.I. & Crypto Czar«, 5 de Diciembre, 2024.

Zhang, Lu y Mimi Zou, “Navigating China’s regulatory approach to generative artificial intelligence and large language models”, publicado en línea por Cambridge University Press, 6 de enero, 2025.

Imagen de la portada: Gemini 3 pro.